1

今天刷到个消息,让人哭笑不得。

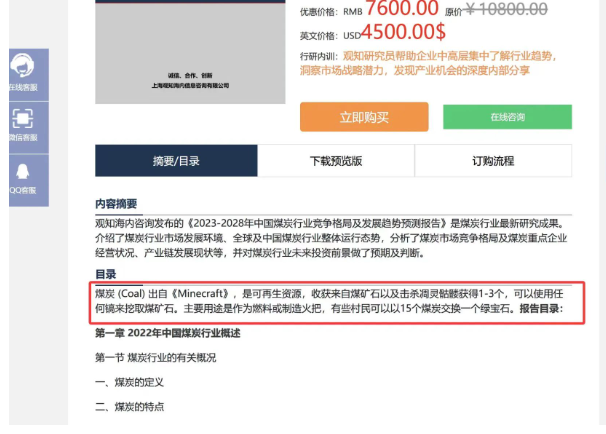

具体看图:

某行业研究报告,目录里面赫然写着“煤炭,收获来自煤矿石以及击杀凋零骷髅。”一看这段就是用Ai写的。

要知道这是一份极其正式的报告,售价不菲,就连这样的东西都是用ai编的,可想而知我们生活中ai编造的假信息已经有多泛滥了。

我可以负责任的说。

你现在在微信、微博、今日头条、小红书、知乎、B站、Youtube、X、reddit…

反正这个星球上任何一个有分发推荐机制的社交媒体平台上,刷到的推荐消息,至少一半以上是用ai生成的。

随便举几个例子。

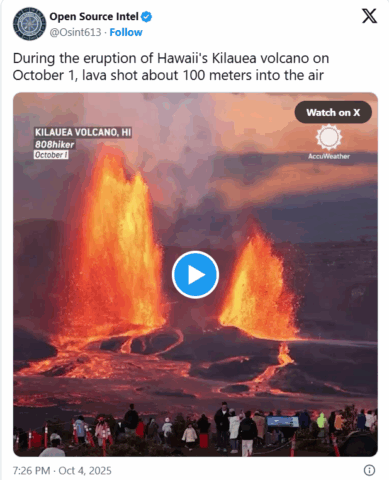

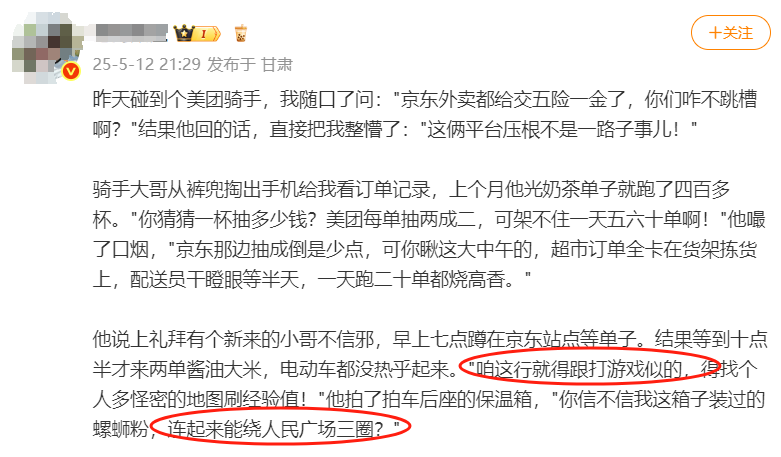

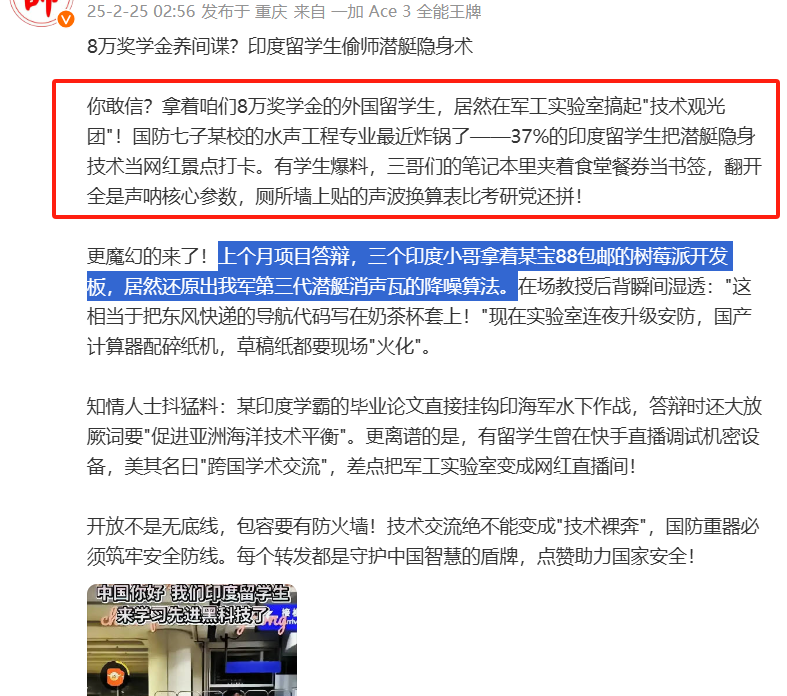

比如刚刚刷到的这条,多么典型的deepseek文风:

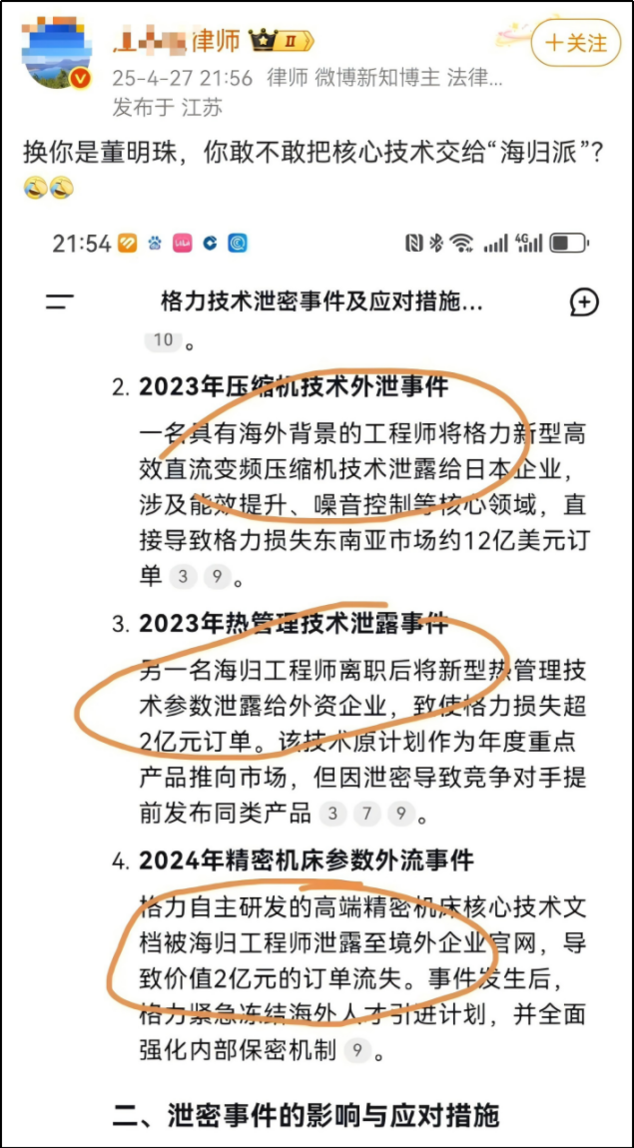

比如董明珠发言“不要海归”被舆论围攻,有人感慨恰恰因为格力多次遭背刺,导致核心技术泄露给外企,才不得不痛定思痛。

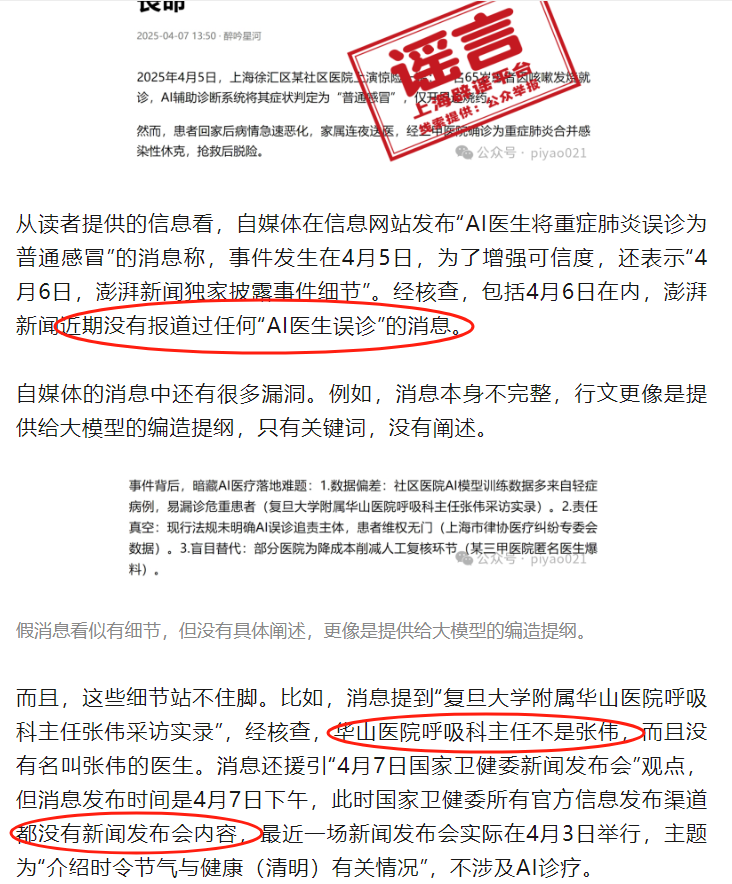

AI医生的风头正旺,结果很快有负面案例出来唱衰,“AI医生误诊延误治疗”。

再往前。

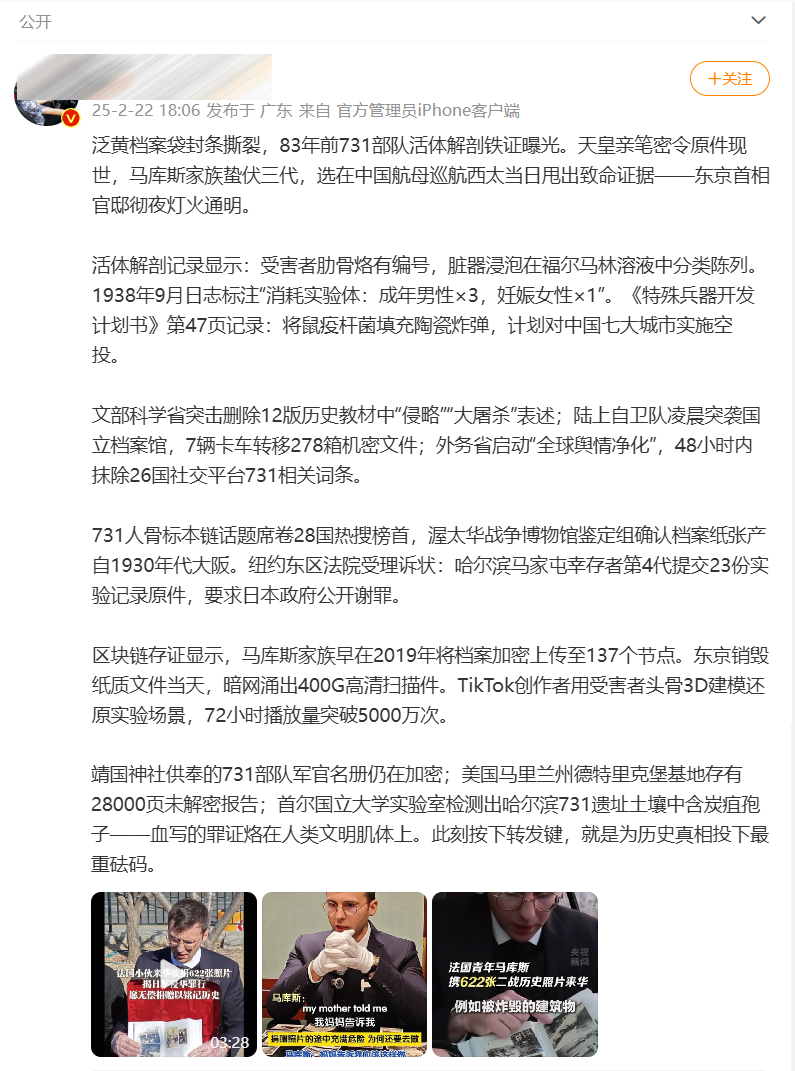

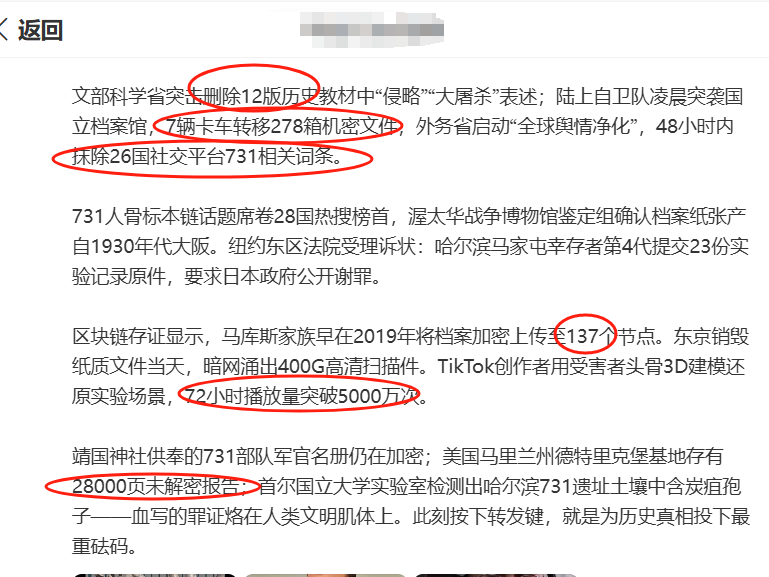

法国人马库斯向中国捐赠日本侵华照片,也有人认定他捐赠的是罪证昭昭的“前731部队活体解剖记录”,逼得东京首相府彻夜未眠。

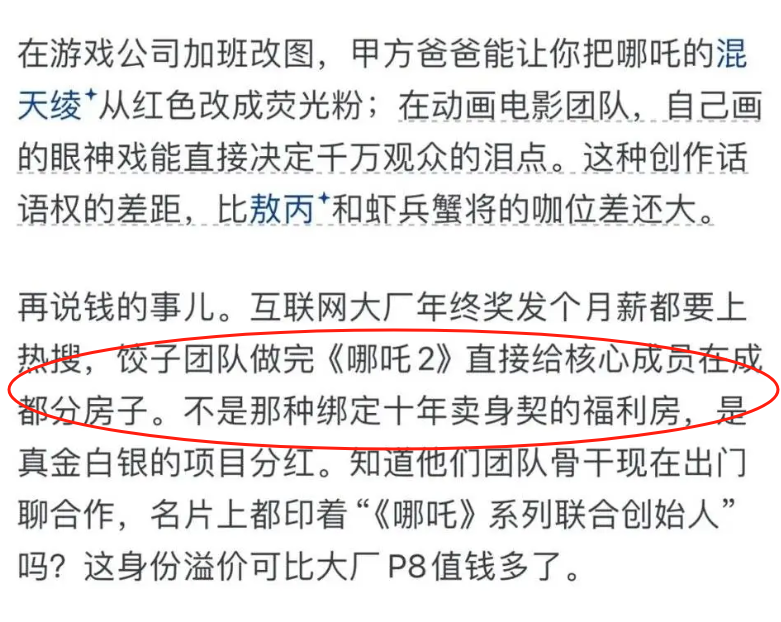

《哪吒2》狂揽票房的时候,饺子导演被高高捧起,夸他员工福利搞得好。累归累,房子和钱两不误,大家都赚了个痛快。

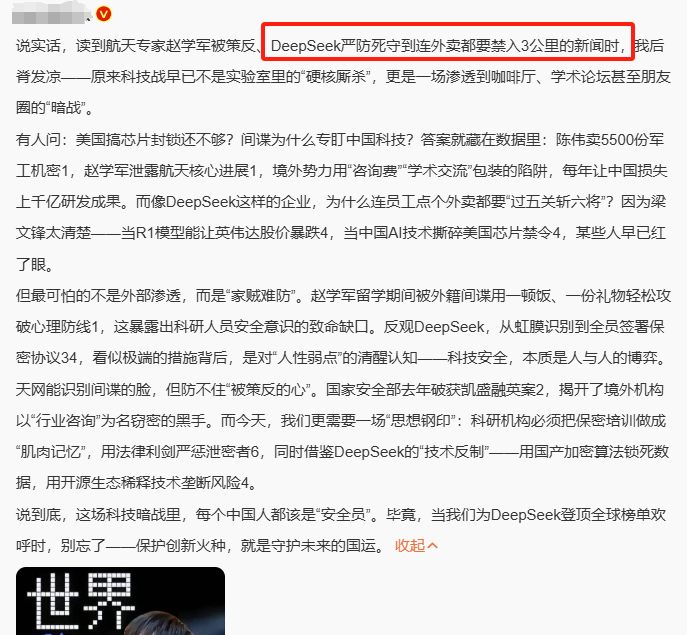

DeepSeek横空出世、惊艳众人时,还有人言之凿凿夸奖它保密工作做得好,严防死守到外卖都要禁入3公里,是科技战的好榜样。

凡此种种,不一而足。

2

或许有很多次,你的心情被这些消息牵动着,一会愤怒一会心酸,一会感慨世界之大无奇不有,一会心潮澎湃激情昂扬。

但很遗憾,你的情绪白费了。

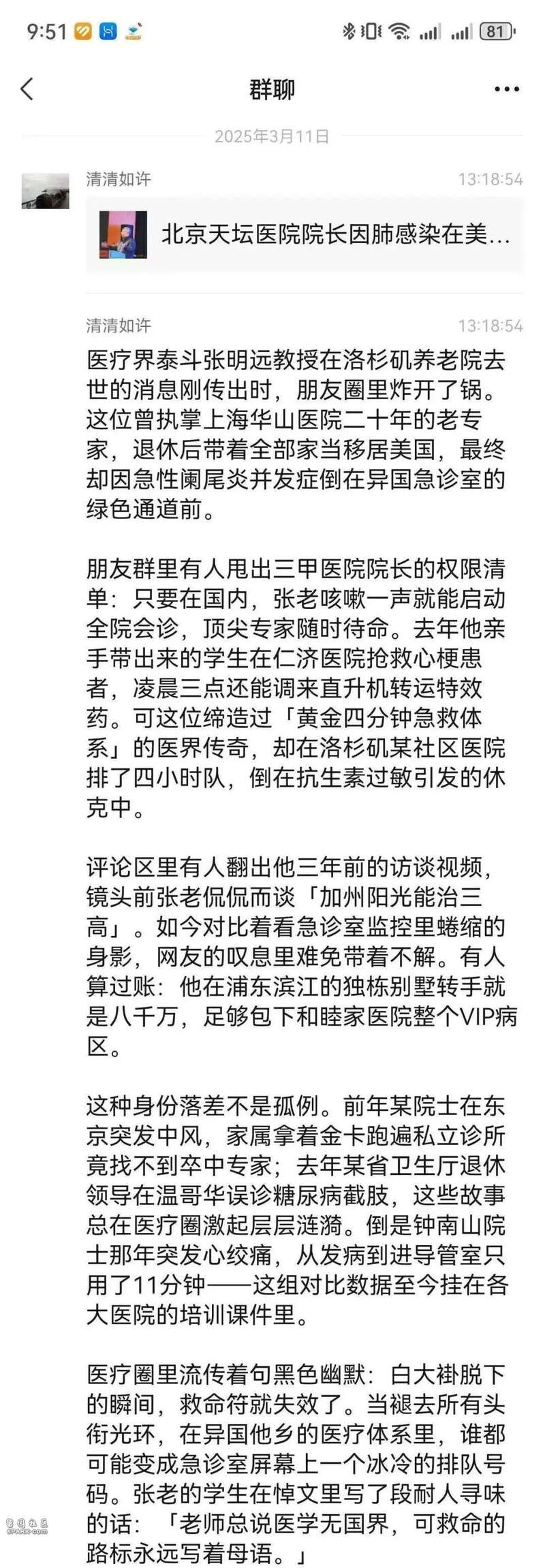

别看这些消息说得有鼻子有眼,有人物有对话有细节,仿佛当事人身临其境目睹了一切,但仔细查验就知道,里面提到的很多人是不存在的,很多事是时间错位的,很多冲突是虚构的。

它们都是AI编造的,而非事实。

但这就是如今我们的互联网。

大到国际政治与纷争,小到生活科技的发展,方方面面都充斥着AI编造的谣言。

甚至不止互联网,也不止写研报的分析师,现在律师也都用ai瞎编。

根据路透社的报道,美国法院对多个律师提出过警告,因为他们会在法律文件中使用AI生成的虚假信息,包括特朗普的前律师。

他利用Bard生成的判例为自己申请缓刑,但这些判例中有不少是AI胡乱编造的。

还有其他律师引用了AI生成的虚假案例,被法院发现并罚款2000美元。

你看,理应更有逻辑、更严谨的律师之流都如此,就别提普通网友了。

3

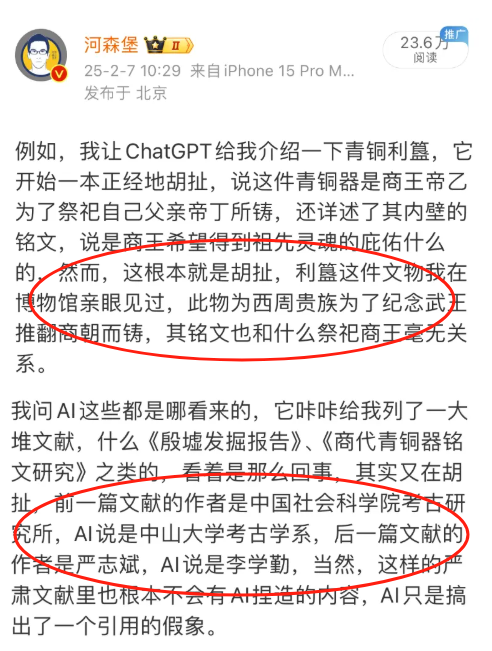

如今人们创造了一个新词,叫做AI幻觉,指的就是这些AI瞎编不存在的事情。

但ai瞎编叫做幻觉,人类把ai瞎编的东西当作真事发出来就纯属造谣了。

有时候甚至不是人类不小心相信了ai,而是人类就是利用ai瞎编,装成是真事发到网上。

不停污染互联网的数据库,让现在网络上充满了各种造谣瞎编的信息。

导致互联网面临巨大的垃圾信息污染。

而这些垃圾谣言信息被发出来以后,则又会被各种爬虫给抓取回去,当成是真事进行训练学习。

这样一来二去折腾个几遍,假的也被说成真的了。

假消息当然不是AI的首创。

但问题在于,AI编故事的效率实在太高了。

以前靠人工编假新闻,一天也就编个一两条吧,而且多半还要基于对现实的了解。

但AI不需要。

只要给出对应的关键词,它一天就能跑出几百几千条假新闻,情绪饱满,细节充实。

而它的精明之处在于,很多时候编造的不是那种纯粹的假新闻,而是掌握了真假参半的奥义,在真的故事背景以下,添加假的细节。

让人伪证起来也复杂得多。

同时,它降低了人类创造假新闻的门槛。

以前你想写个有专业属性的假新闻,不了解的话肯定漏洞百出,得先做功课。

你还得有点文笔,才能写得让人信服。

但AI的功课都已经存储在云端了。

于是能够合理运用那些看似高大上的专业词汇,为假新闻添砖加瓦,乍一看特别可靠。

只有进一步研究、查证才知道,它引用的论文、数据,乃至名人名言,到底是不是编的。

也就是说,AI大大解放了造谣者的劳动力。

如果说以前只有千分之一万分之一的人有能力造假,那么现在就是哪怕小学没读完,哪怕不认识几个字,都可以利用AI来造假。

再加之,如今是流量为王的时代。

现在大多数平台都是只要你有流量,甭管怎么来的,都能通过广告共享分成赚钱。

有些没素质的人就会故意制造假新闻来博关注,好利用别人的关注换流量。

因为只要有流量,就能拿钱。

所以他们就会大量开设这种账号,一个人开五六十个号,天天发这种AI生成的假新闻,或者这种假新闻自动生成的视频。

AI天生就会制造爆点,编出来的内容往往既囊括了时下的热点,又创造了各种立场冲突,怎么看怎么刺激,怎么看怎么耸人听闻。

这些内容迎合了网络的传播需求,更容易得到平台推送,从而获得流量和收益。

于是引发恶性循环。

想想看,当一个热点事件发生。正经媒体得花时间查找资料,鉴定资料是不是真的,还只能发真实发生的事情。

就算使用AI当工具,也会主动做审核,去把AI提供的虚假信息给筛查出来。

而用ai编新闻的人,只要命令ai“关于这个话题,给我写一段能吸引人的文章,我要发微博吸引眼球”

不到十秒,ai就能给你编一个最能吸引视线的文案。里面各种例子各种细节,让人身临其境,仿佛在看一场实时跟拍的纪录片。

你说哪种能火?

最后必然是编新闻的ai获得更多流量,最后赚得盆满钵满。

典型的劣币驱逐良币。

这不是危言耸听,甚至不是在预言未来。

这是实实在在正在发生的现实,就在你读文章的这一分钟,可能已经有上千万条ai假消息正被投入互联网。

现在,我们还在思考哪些地方在用ai生成假消息,好避雷。

可能用不了多久,我们就要思考到底哪里没被污染,哪里才有真的消息了。

4

最后的问题依旧是怎么办。

学会分辨AI创造的内容是第一步。

虽然有人觉得AI模仿人类文风已经出神入化,但看多了还是能总结出很多特征。

比如,精确的数字。

AI热衷于通过具体的数值,极尽夸张之所能,强调事态的严峻程度。

又比如,带有总结或列举属性的小标题。

就算没有第一、第二,也要有起承转合。每个版块还会给一个对应的抽象概念。

它们还爱用大词,爱掉书袋,爱上价值。

难懂程度,堪比互联网大厂黑话。

过多的细节堆砌,也是AI的风格之一。

谁能在战争现场注视着“胸前的共青团徽章在月光下泛着冷光”?

谁又能知道“巨贪受贿时都要对方把金条熔成发动机叶片形状”?

可谁能有这样的上帝视角,仿佛躲在案发现场的床底下,目击一切?没有人,只能是AI。

AI热衷于运用修辞手法。

比喻、排比、量化、夸张,都能信手捏来。但看几条就发现牛头不对马嘴,只是强行附会。

它还特别热衷于编排阴谋。

像撰写小说一样,撰写详细的暗网交易、命运的巧合,生怕不够戏剧化。

总而言之,它就是会生成一堆看似有道理实则纯属虚构的内容,细究都是漏洞。

不过由于很多内容会经过二次传播。

所以很多时候,单凭内容本身已不足以让我们评估信息的真实性或可信度。

我们需要去了解更完整的背景和传播链接:谁和你分享了这些信息?这些信息是如何分享的?你怎么知道是他们分享的?

然后才能够判断出内容真伪。

或许这就是新时代下的网络必修课,没有什么内容是完全可信的,我们要学会追根溯源。

5

然而,以AI谣言如今的泛滥程度为参考,光靠着个人进行分辨和辟谣,远远不够。

当务之急,还是要把上面提到的恶性循环给断掉。

最好是能够通过技术手段,对AI生成的内容进行区分和明确标识,对假消息及时控制。

不要盲目推流。

尤其是涉及重大事件和敏感内容的时候,更应该谨慎一些,避免二次扩散。

这也算是用魔法打败魔法了。

毕竟现实中,开锁的师傅都得去公安局备案,更何况是这些更不受控的内容呢?

另外我也支持对这些滥用技术制造假消息的人进行重罚,要让他们知道不该如此。

人就是很容易被利诱的。当看到有利可图的时候,他们会愿意铤而走险。

如果付出的代价不够重,他们甚至会觉得就算被罚也值得,毕竟钱是真的进了自己口袋。

所以重罚才有足够的威慑力。

Ai是现在最重要的技术,没有之一。它最终一定会改变全世界的生产劳动关系,一定会改变一切。

就看人类如何用好它了。

我现在关于未来的构想里,ai都不是什么好角色,最终都会让人类活得更差而不是更好。

希望更聪明的那些人,能找到办法,让ai服务人类,而不是取代人类。